实测13个类Sora视频生成模型,8000多个案例,一次看个够

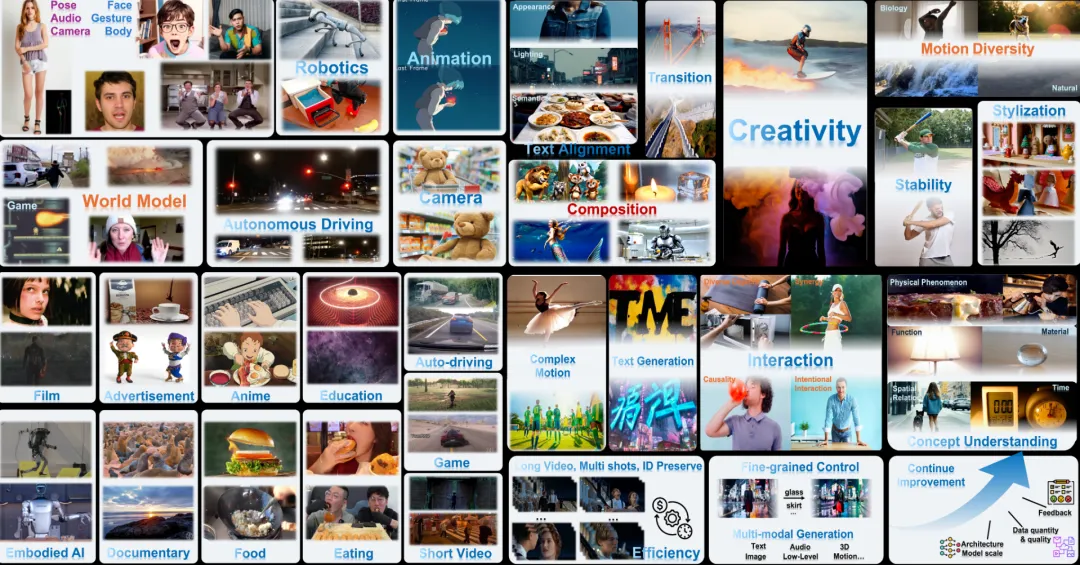

实测13个类Sora视频生成模型,8000多个案例,一次看个够腾讯 AI Lab 联合中科大发布了一份针对类 SORA 视频生成模型的测评报告,重点聚焦目前最前沿的类 SORA DiT 架构的高质量视频生成闭源模型

腾讯 AI Lab 联合中科大发布了一份针对类 SORA 视频生成模型的测评报告,重点聚焦目前最前沿的类 SORA DiT 架构的高质量视频生成闭源模型

在OpenAI Sora的主要技术负责人跑去Google、多个报道指出OpenAI Sora在内部因质量问题而导致难产的节骨眼,Meta毫不客气发了它的视频模型“Movie Gen”,并直接用一个完整的评测体系宣告自己打败了Sora们。

OpenAI又一位关键大牛离职。Sora负责人刚刚官宣,离职OpenAI加盟谷歌DeepMind,恰好是在今天canvas发布之际。

面对以 Sora 为代表的各种「后辈」视频生成模型的冲击,Pika 迟迟没有大的版本更新。

9月 24 日,字节跳动的豆包大模型发布多款新品——视频生成、音乐生成以及同声传译大模型。

Sora深陷研究困境? Sora在今年二月发布后,至今还是「期货」,为何迟迟不开放呢

AI文生视频领域,几乎只剩Sora还是个期货了。

自从 Sora 发布以来,AI 视频生成领域变得更加「热闹」了起来。过去几个月,我们见证了即梦、Runway Gen-3、Luma AI、快手可灵轮番炸场。

OpenAI 在人工智能领域的领头羊地位家喻户晓。其产品聊天机器人 ChatGPT 系列、文生图 DALL・E 系列、文生视频 Sora 等都被誉为生产力提升的超强助手

今年是 AI 视频生成爆发的元年,以 Sora 为代表的算法模型和产品应用不断涌现。短短几个月内,我们目睹了几十种视频生成工具的问世,基于 AI 的视频创作方式开始流行起来。